Le nettoyage des données est le premier pas vers une analyse fiable. Pourtant, il est souvent jugé fastidieux et chronophage, particulièrement lorsqu’on doit gérer une grande quantité d’informations. Chaque entreprise, petite ou grande, a besoin de s’assurer que ses données sont à jour, précises et prêtes à être analysées. Dans cet article, nous allons explorer cinq outils qui peuvent automatiser ces processus de nettoyage des données. Grâce à ces solutions, le temps investi dans le traitement des données diminue, tout en augmentant la qualité des résultats de vos analyses. Que vous soyez un spécialiste des données ou un novice cherchant à optimiser votre travail, certains de ces outils peuvent transformer votre approche de la gestion des données. Nous allons passer en revue leurs fonctionnalités, leurs avantages et inconvénients, afin de vous donner une vue d’ensemble claire et précieuse pour faire un choix éclairé.

Qu’est-ce que le nettoyage des données ?

Le nettoyage des données est une étape cruciale dans le processus de préparation des données. Cela implique un ensemble de méthodes et de techniques qui garantissent que les données utilisées pour les analyses sont précises, fiables et pertinentes. Dans le monde où les données sont générées à une vitesse incroyable, il est fréquent de rencontrer des informations erronées, incomplètes ou incohérentes. Ces erreurs peuvent être dues à plusieurs facteurs, comme des fautes de saisie, des doublons ou encore des informations périmées. Par conséquent, le nettoyage des données représente un investissement indéniable pour garantir la qualité des résultats analytiques.

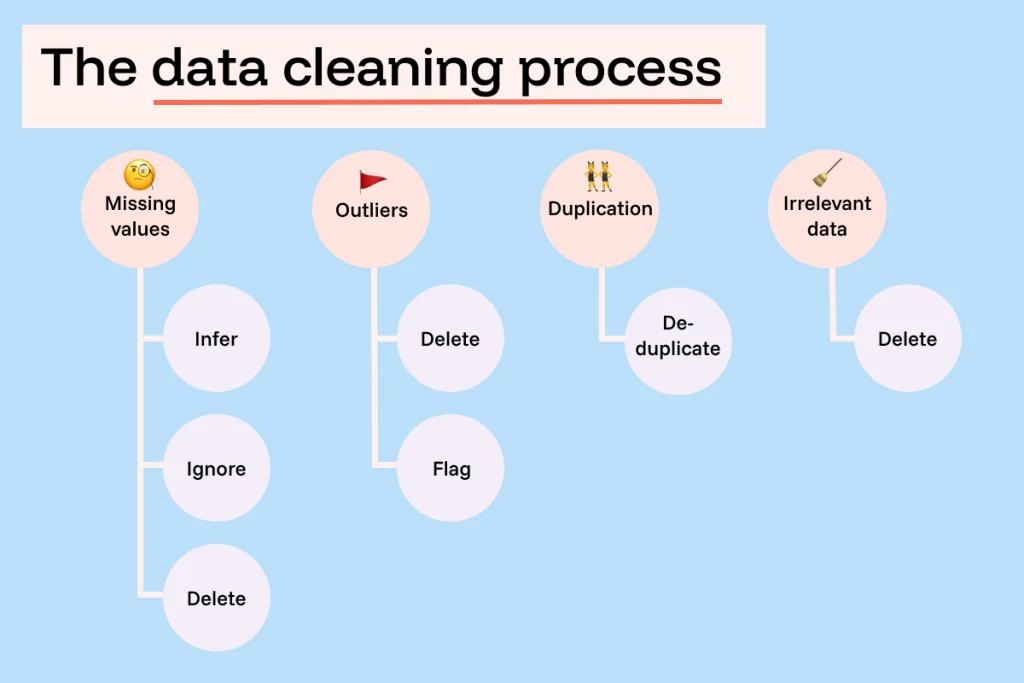

Les types d’erreurs fréquentes rencontrées lors de l’analyse de données incluent :

- Valeurs manquantes : Il s’agit d’entrées qui n’ont pas été renseignées. Par exemple, un fichier client peut manquer des informations sur les adresses e-mail, nuisant ainsi à toute campagne de marketing.

- Doublons : Des enregistrements répétés peuvent fausser les résultats, en créant un biais dans les analyses. Un exemple courant est un même client inscrit plusieurs fois dans une base de données.

- Incohérences : Cela se réfère à des données qui ne sont pas uniformes. Par exemple, un client peut être enregistré sous différents noms ou formats d’adresse.

- Erreurs typographiques : Les fautes d’orthographe lors de la saisie des données peuvent entraîner des problèmes majeurs lorsqu’il s’agit d’analyser ou de cartographier des informations.

Un nettoyage minutieux est fondamental avant de procéder à toute analyse de données, car des données de mauvaise qualité peuvent conduire à des décisions erronées. Imaginez une entreprise qui s’appuie sur des données nettoyées pour prendre des décisions stratégiques. Des erreurs dans les données peuvent entraîner des investissements financiers malavisés, le développement de produits non pertinents ou une mauvaise segmentation des clients. Pour éviter ces pièges, il est essentiel d’adopter des pratiques rigoureuses de nettoyage des données. Les techniques de nettoyage peuvent inclure la normalisation, la validation des données et le dédoublonnage, pour ne citer que quelques exemples.

Pour mieux comprendre l’importance du nettoyage des données, prenons un exemple concret : une ONG qui recueille des fonds pour ses programmes. Si les données de leurs donateurs sont chargées d’erreurs, cela pourrait non seulement entraîner des pertes financières, mais aussi nuire à la réputation de l’organisation. Des informations comme des adresses incorrectes peuvent signifier des envois de courriers perdus, tandis que des doublons peuvent donner l’impression que l’ONG a une base de donateurs plus solide qu’elle ne l’est réellement.

Pour en savoir plus sur le nettoyage des données et découvrir des méthodes efficaces pour y parvenir, vous pouvez consulter ce lien qu’ici. En effet, le nettoyage des données n’est pas seulement une étape obligatoire, mais un véritable atout stratégique pour toute organisation souhaitant prendre des décisions éclairées et basées sur des données fiables.

Fonctionnalités clés des outils de nettoyage des données

Les outils de nettoyage des données sont devenus essentiels pour toute entreprise cherchant à optimiser ses processus et à s’assurer que les décisions prises reposent sur des données fiables. Les fonctionnalités clés qu’ils offrent sont variées et jouent un rôle crucial dans la qualité des données. Parmi celles-ci, la correction des erreurs est sans doute l’une des plus fondamentales. Ce processus consiste à identifier et à rectifier les erreurs telles que les fautes de frappe, les incohérences dans les formats de données ou les valeurs non valides. Grâce à des algorithmes avancés, ces outils sont capables de détecter des anomalies qui pourraient passer inaperçues à l’œil nu.

Un autre aspect important est la gestion des données manquantes. Dans de nombreux ensembles de données, certaines valeurs peuvent être absentes, ce qui peut affecter l’analyse et la prise de décisions. Les outils de nettoyage des données proposent plusieurs stratégies pour traiter ces lacunes, allant de la suppression des enregistrements incomplets à l’imputation de valeurs en fonction des tendances observées dans le reste des données. Cela permet de conserver une base de données aussi complète et précise que possible, tout en minimisant l’impact des données manquantes sur les résultats finaux.

Enfin, la déduplication est une autre fonctionnalité clé. La duplication de données peut entraîner des analyses erronées et une mauvaise interprétation des informations. Les outils modernes utilisent des techniques sophistiquées pour identifier les doublons et les fusionner en un seul enregistrement, garantissant ainsi que chaque valeur est unique et représentative. Cette capacité est particulièrement utile dans des secteurs tels que le marketing ou la finance, où des données précises et sans duplication sont essentielles pour les campagnes et les prévisions.

En utilisant ces fonctionnalités, les entreprises peuvent améliorer significativement la qualité des données sur lesquelles elles reposent. En combinant la correction des erreurs, la gestion des données manquantes et la déduplication, ces outils permettent de créer un environnement où les décisions sont basées sur des données fiables et exploitables. Pour avoir un aperçu des différentes méthodologies de nettoyage des données, vous pouvez consulter cet article disponible ici. En somme, investir dans ces fonctionnalités représente une stratégie sur le long terme pour toute organisation soucieuse de sa performance et de son intégrité analytique.

OpenRefine : Un outil polyvalent

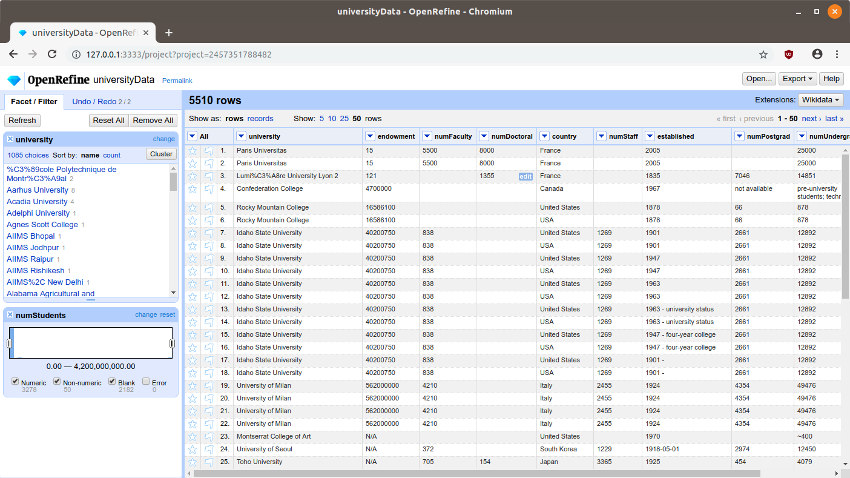

OpenRefine, anciennement connu sous le nom de Google Refine, est un outil puissant conçu pour aider les utilisateurs à nettoyer et à explorer des ensembles de données. Grâce à son interface intuitive, il permet de travailler facilement sur des données désordonnées, de naviguer à travers les lignes et les colonnes, et d’appliquer des transformations complexes sans avoir besoin de compétences approfondies en programmation.

Les fonctionnalités d’OpenRefine sont variées et conçues pour répondre à de nombreux besoins en matière de nettoyage de données. Parmi les fonctionnalités les plus remarquables, on trouve :

- Facilité d’importation : OpenRefine prend en charge plusieurs formats de fichiers, y compris CSV, TSV, et Excel, permettant aux utilisateurs d’importer facilement leurs données.

- Analyse des données : L’outil permet aux utilisateurs d’explorer les données grâce à des facettes, gérant ainsi des ensembles de données volumineux et facilitant la découverte de tendances ou d’anomalies.

- Nettoyage en masse : OpenRefine propose des fonctions de nettoyage puissantes, telles que la normalisation des valeurs, la suppression des doublons, et la transformation de données en fonction de règles définies.

- Extensibilité : Grâce à son support des plugins et des extensions, OpenRefine peut être adapté pour répondre à divers besoins spécifiques, le rendant ainsi polyvalent pour différents utilisateurs.

Les avantages d’OpenRefine ne s’arrêtent pas à ses fonctionnalités. Cet outil est particulièrement avantageux pour :

- Les chercheurs et universitaires : OpenRefine est souvent utilisé pour nettoyer des données issues de combinaisons de sources hétérogènes, ce qui est fréquent dans le cadre de projets de recherche.

- Les journalistes de données : La capacité d’OpenRefine à traiter rapidement des ensembles de données peut faire la différence dans la collecte d’informations pertinentes pour un article ou un reportage.

- Les analystes de données : Pour ceux qui travaillent avec des jeux de données volumineux, cet outil constitue un allié en économisant du temps et en améliorant la précision des analyses.

Cependant, bien qu’OpenRefine offre de nombreux avantages, il présente également quelques inconvénients. Par exemple, la courbe d’apprentissage peut être un peu ardue pour les utilisateurs novices en matière de traitement de données. De plus, les utilisateurs peuvent parfois rencontrer des limitations avec certains formats de données moins courants. Une fois ces défis surmontés, OpenRefine devient un atout inestimable pour quiconque cherche à améliorer la qualité de ses données.

En illustrant son utilisation, imaginons un chercheur étudiant l’impact du changement climatique sur la biodiversité. Grâce à OpenRefine, il peut fusionner de nombreuses bases de données provenant de différentes publications, nettoyer les valeurs incohérentes sur les espèces et les habitats, et présenter des résultats précis. Un autre exemple pourrait être celui d’un journaliste assemblant des données sur les dépenses publiques. En appliquant des facettes, il peut rapidement isoler et analyser les catégories de dépenses les plus élevées, tirant ainsi des conclusions éclairées pour son enquête.

Dans l’ensemble, OpenRefine est un outil qui combine puissance et flexibilité, adapté à une vaste gamme d’applications dans le domaine de la gestion des données, démontrant son importance dans la quête de données fiables et exploitables.

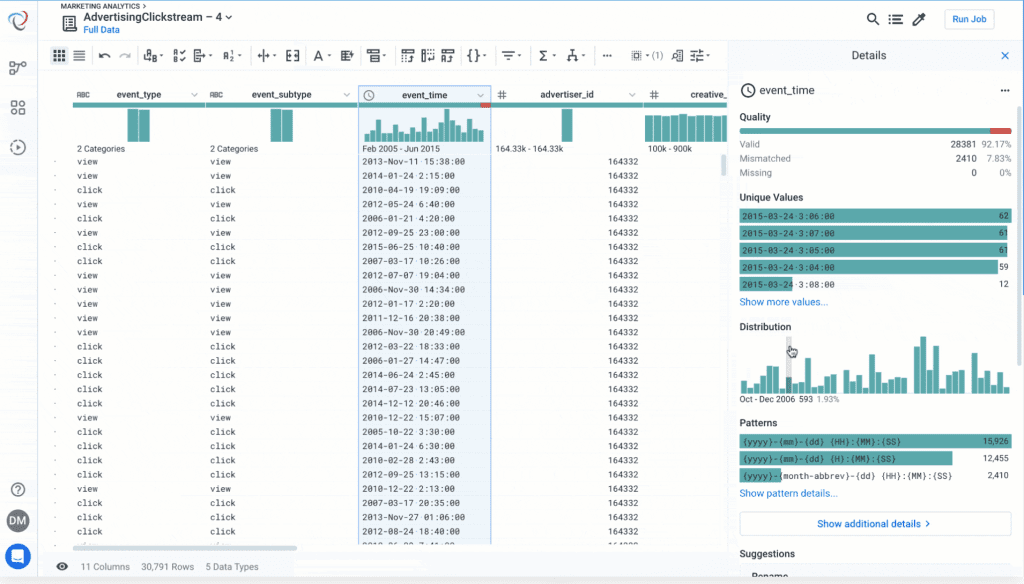

Trifacta Wrangler: La Force Du Machine Learning

Trifacta Wrangler est un outil de préparation de données qui s’appuie sur l’apprentissage automatique pour aider les utilisateurs à simplifier le processus complexe de nettoyage et de transformation des données. Son interface conviviale rend cet outil accessible aux utilisateurs novices tout en offrant des fonctionnalités avancées pour les professionnels expérimentés. Grâce à l’apprentissage automatique, Trifacta Wrangler identifie automatiquement les types de données, les anomalies et les schémas, facilitant ainsi le travail de prétraitement qui est souvent long et fastidieux.

Une des caractéristiques marquantes de Trifacta est son interface graphique intuitive qui permet aux utilisateurs de glisser-déposer les colonnes de données afin de les transformer en un clin d’œil. Ce niveau de convivialité est particulièrement bénéfique pour les utilisateurs moins expérimentés, leur permettant d’apprendre de manière progressive tout en expérimentant les différentes options offertes par l’outil. Pour les utilisateurs plus avancés, Trifacta Wrangler propose également la création de scripts et la personnalisation des transformations de données, ce qui peut être essentiel pour gérer des cas d’utilisation plus complexes.

Un des grands atouts de Trifacta Wrangler réside dans ses suggestions intelligentes. L’outil utilise l’apprentissage automatique pour proposer des transformations pertinentes basées sur les données à disposition. Cela signifie que même un utilisateur novice peut être guidé à travers le processus de nettoyage des données sans avoir à avoir une connaissance approfondie des techniques de nettoyage. Les suggestions intégrées aident à réduire les erreurs et à accélérer le processus de préparation.

Cependant, avant de faire le choix de Trifacta Wrangler, il est essentiel de prendre en compte certains éléments. D’abord, il est important de considérer le coût de l’outil, qui peut varier en fonction des fonctionnalités sélectionnées. De plus, même si l’outil est conçu pour être accessible, un certain niveau de familiarité avec les concepts de gestion des données est toujours recommandé pour tirer pleinement parti de ses capacités. Il est aussi utile de se poser la question de l’intégration de cet outil avec les systèmes existants d’une entreprise. Trifacta offre des options d’intégration avec divers systèmes de stockage et d’analyse de données, mais cela nécessite souvent une configuration technique initiale.

Enfin, la gestion des données sensibles doit être pris en compte, car le traitement de données personnelles ou critiques peut nécessiter des précautions supplémentaires. En somme, Trifacta Wrangler s’avère être une solution puissante pour l’automatisation du nettoyage des données, alliant des possibilités d’apprentissage automatique et une interface utilisateur engageante. Pour ceux qui recherchent des méthodes de nettoyage des données, il est conseillé de se renseigner davantage sur les méthodes de nettoyage disponibles pour s’assurer que cet outil répond aux besoins spécifiques de leur projet.

Les autres outils à considérer

En explorant les différentes options pour l’automatisation des processus de nettoyage des données, il est essentiel de considérer d’autres outils qui, bien qu’ils n’aient pas été abordés précédemment, offrent des fonctionnalités intéressantes. Parmi ceux-ci, nous avons Talend Open Studio, Pandas et DataCleaner.

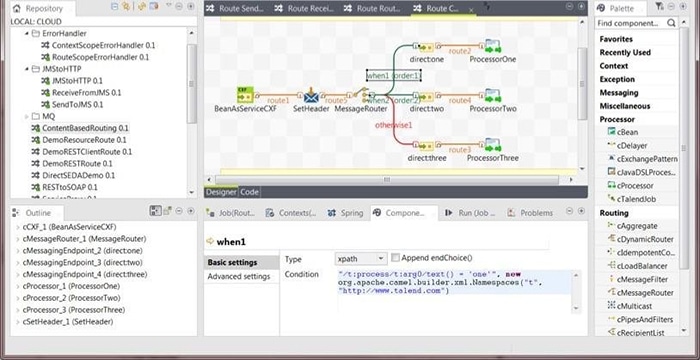

Talend Open Studio est un environnent de développement intégré (IDE) puissant qui permet aux utilisateurs de concevoir des processus de gestion des données. Sa principale force réside dans son interface graphique intuitive, qui facilite le glisser-déposer d’éléments pour construire des flux de travail complexes. Talend propose un ensemble de composants préconstruits, ce qui signifie que les utilisateurs n’ont pas besoin de coder chaque étape, ce qui peut réduire le temps et les coûts liés à la mise en œuvre. Talend Open Studio est particulièrement adapté pour les entreprises ayant besoin d’intégrations entre divers systèmes et sources de données. Pour une exploration approfondie des outils de nettoyage des données, vous pouvez consulter cet article sur Astera.

Ensuite, nous avons Pandas, une bibliothèque de Python qui est devenue une référence incontournable dans le domaine de la science des données. Bien qu’il ne s’agisse pas d’un outil de nettoyage dédié comme certains des autres mentionnés, la flexibilité et la puissance de Pandas permettent une manipulation et une analyse des données très efficaces. Les utilisateurs peuvent facilement gérer des ensembles de données volumineux, identifier les valeurs manquantes, et appliquer des fonctions personnalisées pour les nettoyer. Pandas est recommandé pour ceux qui ont une certaine familiarité avec la programmation Python et qui souhaitent bénéficier d’une approche plus personnalisable. La capacité à traiter les données en mémoire et à effectuer des analyses rapides en fait un choix judicieux pour les projets nécessitant des traitements complexes.

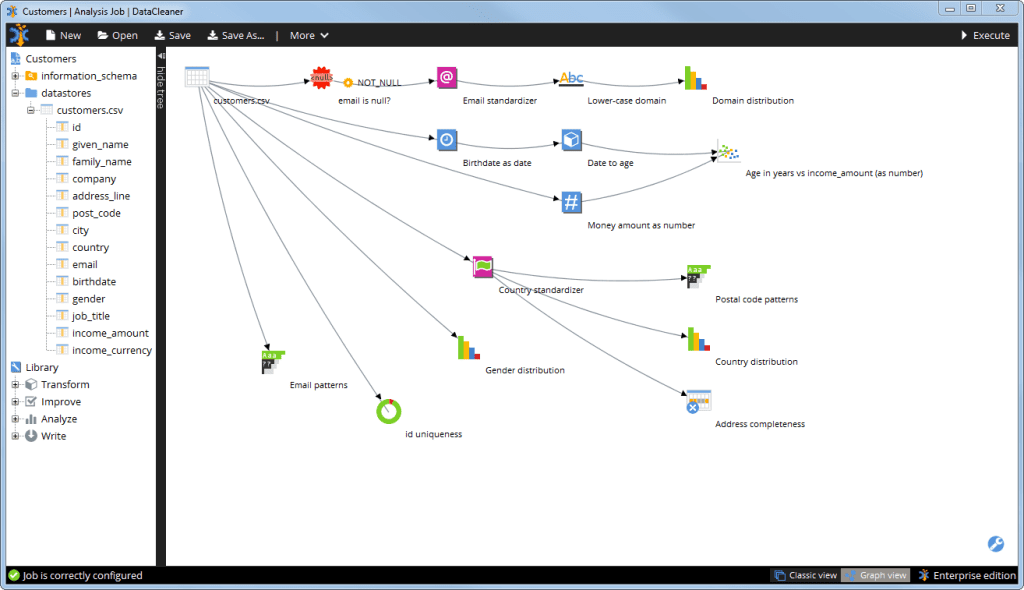

Enfin, DataCleaner se distingue par sa capacité à effectuer des analyses de qualité des données et à fournir des visualisations intuitives. L’outil, orienté vers l’utilisateur, offre une interface conviviale qui permet d’effectuer des vérifications, des nettoyages et des enrichissements de données sans nécessiter de compétences avancées en programmation. DataCleaner est adapté aux petites et moyennes entreprises qui cherchent à améliorer la qualité de leurs données sans un investissement lourd en formation ou en ressources. Avec ses fonctionnalités de validation automatique des données et ses rapports détaillés, cet outil est idéal pour identifier rapidement les anomalies et mettre en place des solutions adaptées.

En résumé, chacun de ces outils apporte des atouts spécifiques qui peuvent enrichir le processus de nettoyage des données, selon les besoins de chaque utilisateur et organisation. Qu’il s’agisse de Talend Open Studio pour l’intégration, de Pandas pour les analyses poussées ou de DataCleaner pour une approche accessible, il existe des solutions variées pour répondre aux enjeux du nettoyage des données.

Conclusion

En conclusion, le nettoyage des données ne doit pas être une corvée ennuyeuse. Les cinq outils que nous avons explorés peuvent véritablement révolutionner votre manière de traiter et d’organiser vos données. Que vous choisissiez OpenRefine pour sa flexibilité, Trifacta Wrangler pour ses capacités d’apprentissage automatique, Talend Open Studio pour son interface graphique, Pandas pour sa puissance scriptée ou DataCleaner pour son accessibilité, chacun a des caractéristiques uniques qui peuvent répondre à vos besoins spécifiques. N’oubliez pas toutefois que ces outils ne sont pas une solution miracle. Ils nécessitent un certain investissement en temps pour comprendre leurs capacités et optimiser leur utilisation. Même si la plupart des ces outils sont abordables, une formation adéquate serait bénéfique pour tirer le meilleur parti de leurs fonctionnalités.

Finalement, en intégrant ces outils dans votre flux de travail, vous pouvez non seulement améliorer la qualité de vos données, mais également votre prise de décisions. En effet, des données propres et fiables sont le fondement d’une stratégie d’analyse solide. Demandez-vous : êtes-vous prêt à embaucher ces roboticiens pour nettoyer vos vieux fichiers poussiéreux?

FAQ

Pourquoi le nettoyage des données est-il important?

Le nettoyage des données est essentiel pour garantir l’exactitude et la fiabilité des analyses. Des données sales peuvent engendrer des décisions erronées, impactant ainsi profondément vos affaires.

Quels sont les principaux outils de nettoyage des données disponibles?

Les outils mentionnés dans cet article incluent OpenRefine, Trifacta Wrangler, Talend Open Studio, Pandas et DataCleaner.

Ces outils nécessitent-ils des compétences techniques?

Oui, certains outils comme Pandas requièrent des compétences en programmation, tandis que d’autres comme DataCleaner sont plus accessibles aux utilisateurs non techniques.

Comment choisir le bon outil pour mon entreprise?

Évaluez vos besoins spécifiques : volume de données à traiter, type de données, compétences techniques de l’équipe et budget. Chaque outil a ses propres avantages et inconvénients.

Est-ce que ces outils sont coûteux?

La plupart des outils listés sont gratuits ou open source, mais certains peuvent avoir des coûts associés selon les fonctionnalités avancées ou le support technique offert.

⭐ Analytics engineer, Data Analyst et Automatisation IA indépendant ⭐

- Ref clients : Logis Hôtel, Yelloh Village, BazarChic, Fédération Football Français, Texdecor…

Mon terrain de jeu :

- Data Analyst & Analytics engineering : tracking avancé (GTM server, e-commerce, CAPI, RGPD), entrepôt de données (BigQuery, Snowflake, PostgreSQL, ClickHouse), modèles (Airflow, dbt, Dataform), dashboards décisionnels (Looker, Power BI, Metabase, SQL, Python).

- Automatisation IA des taches Data, Marketing, RH, compta etc : conception de workflows intelligents robustes (n8n, App Script, scraping) connectés aux API de vos outils et LLM (OpenAI, Mistral, Claude…).

- Engineering IA pour créer des applications et agent IA sur mesure : intégration de LLM (OpenAI, Mistral…), RAG, assistants métier, génération de documents complexes, APIs, backends Node.js/Python.